在数据驱动决策的今天,数据服务已成为企业数字化转型的核心引擎。其技术架构的选型直接关系到数据价值释放的效率、系统的可维护性与未来的扩展潜力。一个明智的选型需要综合考虑业务需求、数据特征、团队技能与成本预算,旨在构建一个高效、灵活且可靠的数据基石。

一、 核心选型维度与考量

- 数据处理范式:批处理 vs. 流处理

- 批处理:适用于对海量历史数据进行离线计算、分析报表、数据仓库ETL等场景。主流技术包括Apache Hadoop (MapReduce)、Apache Spark、传统关系型数据库及MPP数据库(如Greenplum)。选型关键在于计算吞吐量、资源利用率和生态工具链的成熟度。

- 流处理:适用于实时监控、实时风控、实时推荐等对延迟敏感的场景。主流技术包括Apache Flink、Apache Kafka Streams、Apache Storm以及云服务商提供的托管流服务。选型需重点评估其延迟表现、Exactly-Once语义保证、状态管理能力及与消息队列的集成度。

- 混合架构(Lambda/Kappa):为兼顾批流一体化需求,Lambda架构(批流并行)或更简化的Kappa架构(全流处理)成为趋势。选型时需评估框架对两种处理模式的原生支持程度,如Apache Spark Structured Streaming与Apache Flink的统一批流API。

- 数据存储与数据库选型

- OLTP(事务处理):支撑核心业务系统,要求高并发、低延迟、强一致性。可选传统关系数据库(MySQL, PostgreSQL)、NewSQL(如TiDB, CockroachDB)或云原生数据库(AWS Aurora, PolarDB)。

- OLAP(分析处理):服务于分析与决策,侧重复杂查询的吞吐量。可选列式存储数据仓库(如Snowflake, BigQuery, Redshift)、开源MPP引擎(ClickHouse, Druid, StarRocks)或基于Hadoop的SQL引擎(Hive, Impala, Presto)。需权衡查询性能、数据规模、并发能力与成本。

- NoSQL数据库:根据数据模型灵活选择。文档型(MongoDB, Couchbase)适用于半结构化数据;宽列存储(Cassandra, HBase)适合海量时序或宽表数据;图数据库(Neo4j)擅长关系挖掘;键值存储(Redis)则是缓存的优选。

- 数据集成与传输

- 需要可靠、高效的数据管道将数据从源头移至处理与存储层。工具如Apache Kafka(消息队列/流平台)、Debezium(变更数据捕获)、Airbyte/Fivetran(ETL工具)、以及DataX/Sqoop(批量传输)是常见选择。评估标准包括吞吐量、延迟、数据格式支持、监控运维能力及对源端和目标端生态的连接器丰富度。

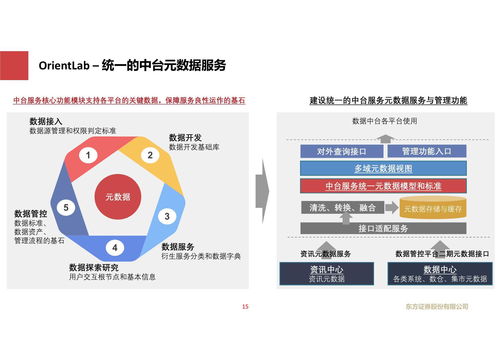

- 元数据管理与数据治理

- 随着数据栈复杂化,元数据管理(如Apache Atlas, DataHub, Amundsen)和数据治理平台变得至关重要,用于实现数据血缘、质量监控、权限管控与数据发现,这是保障数据服务可信度和可用性的基础。

- 部署与运维模式:云原生 vs. 本地化

- 云原生:优先考虑全托管服务(如AWS Glue, Azure Data Factory, GCP Dataflow)或基于Kubernetes的容器化部署(使用Helm charts或Operator)。优势在于弹性伸缩、降低运维负担、快速集成云上生态,但需关注厂商锁定与长期成本。

- 本地化/混合云:出于数据安全、合规或已有投资保护,可能选择在私有环境中部署开源套件或商业发行版(如Cloudera CDP)。这对团队的技术运维能力要求更高。

二、 选型实践建议

- 从业务场景出发,避免技术镀金:清晰定义数据服务的SLA(如数据新鲜度、查询延迟、可用性要求),选择最匹配而非最前沿的技术。

- 评估团队技能与学习曲线:选择社区活跃、文档完善、人才市场供给充足的技术栈,以降低实施与维护风险。

- 重视生态集成与开放性:优先选择能与现有系统(如身份认证、监控告警)良好集成,并支持开放标准与协议(如SQL, Parquet/ORC格式)的组件,保证架构的互操作性和可替换性。

- 设计可演进与模块化的架构:避免单一技术栈绑定。通过抽象层(如统一查询服务层)隔离底层技术细节,使存储与计算引擎能够根据业务发展独立迭代与替换。

- 进行概念验证与性能基准测试:对于关键组件,务必在模拟真实数据和负载的环境中进行PoC,量化评估其性能、稳定性与资源消耗,为最终决策提供数据支撑。

****

数据服务的技术架构选型是一个持续权衡与迭代的过程,没有“银弹”。成功的选型始于对业务价值的深刻理解,成于对技术特性的精准把握与务实组合。构建一个分层解耦、弹性可靠、并能伴随数据增长而平滑演进的技术栈,方能支撑企业在数据浪潮中行稳致远,将数据真正转化为核心竞争力。